新加坡網(wǎng)絡(luò)安全局發(fā)布《AI系統(tǒng)安全指南》

責(zé)編:gltian |2024-10-21 16:46:12文/麻策律師

新加坡在人工智能領(lǐng)域的安全治理野望,屬于路人皆知的存在。

繼新加坡在2024年5月30日發(fā)布的《生成式人工智能的治理框架》,2024年9月 23日新加坡最高人民法院發(fā)布《關(guān)于法院用戶使用生成式人工智能工具指南》之后,新加坡又雙叒叕發(fā)布和AI安全有關(guān)的指南。

2024年10月15日,新加坡網(wǎng)絡(luò)安全局 (CSA) 制定并一口氣發(fā)布了 《AI 系統(tǒng)安全指南》及其配套指南——《AI 系統(tǒng)安全配套指南》,以幫助系統(tǒng)所有者在 AI 的整個生命周期內(nèi)保護(hù) AI。這兩個指南將有助于保護(hù) AI 系統(tǒng)免受供應(yīng)鏈攻擊等傳統(tǒng)網(wǎng)絡(luò)安全風(fēng)險和對抗性機(jī)器學(xué)習(xí)等新風(fēng)險的影響。

指南可以稱作是網(wǎng)絡(luò)協(xié)作的典型,本身并不屬于法規(guī)規(guī)范,而是來自工業(yè)界和學(xué)術(shù)界的實用措施、安全控制和最佳實踐,引用了 MITRE ATLAS 數(shù)據(jù)庫和 OWASP 機(jī)器學(xué)習(xí)和生成式 AI 的 10 大資源。

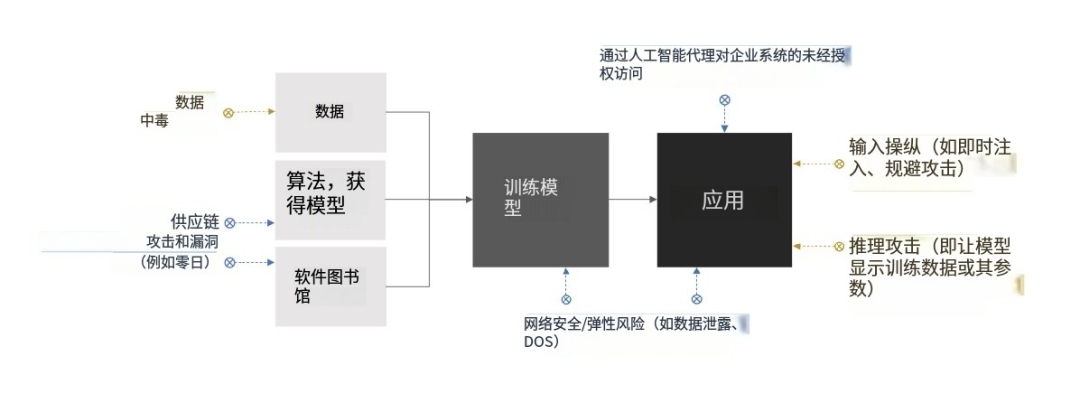

新加坡認(rèn)為,要獲得 AI 的好處,用戶必須確信 AI 將按設(shè)計運行,并且結(jié)果是安全可靠的。但是,除了安全風(fēng)險之外,AI 系統(tǒng)還可能容易受到對抗性攻擊,惡意行為者會故意操縱或欺騙 AI 系統(tǒng)。AI 的采用可能會給企業(yè)系統(tǒng)帶來或加劇現(xiàn)有的網(wǎng)絡(luò)安全風(fēng)險。這可能會導(dǎo)致數(shù)據(jù)泄露或數(shù)據(jù)泄露等風(fēng)險,或?qū)е掠泻虿幌M哪P徒Y(jié)果。

因此,作為一項關(guān)鍵原則,AI 應(yīng)該在設(shè)計上是安全的,并且與所有軟件系統(tǒng)一樣,應(yīng)該是默認(rèn)安全的。這將使系統(tǒng)所有者能夠管理上游的安全風(fēng)險。這將補(bǔ)充系統(tǒng)所有者為解決 AI 安全問題而可能采取的其他控制和緩解策略,以及公平性或透明度等其他隨之而來的考慮因素,這些因素在此處未涉及。

誰應(yīng)當(dāng)看?

指南認(rèn)為其面向的對象主要分為三類,一是負(fù)責(zé)監(jiān)督??智能系統(tǒng)實施??智能的戰(zhàn)略和運營??的決策人員,即負(fù)責(zé)制定??智能計劃的愿景和?標(biāo)、定義產(chǎn)品要求、分配資源、確保合規(guī)性以及評估?險和效益的人員,角色包括產(chǎn)品經(jīng)理、項目經(jīng)理。

其二,包括負(fù)責(zé)AI整個生命周期的實際應(yīng)用開發(fā)的從業(yè)人員(即設(shè)計、開發(fā)和實施人工智能模型和解決方案),如人工智能/ML 開發(fā)人員、人工智能/ML 工程師、數(shù)據(jù)科學(xué)家。

最后,包括?絡(luò)安全從業(yè)?員,即負(fù)責(zé)確保??智能系統(tǒng)的安全性和完整性的人員,包括IT 安全從業(yè)人員、網(wǎng)絡(luò)安全專家。

從?險評估開始

人工智能系統(tǒng)所有者應(yīng)考慮從?險評估??,重點關(guān)注??智能系統(tǒng)的安全?險,其次,根據(jù)?險程度、影響和可?資源,確定應(yīng)對?險的優(yōu)先次序,再次確定并實施相關(guān)?動,確保??智能系統(tǒng)的安全,最后評估殘余?險,以減輕或接受?險。

1. 規(guī)劃設(shè)計

要保持全員提高對AI安全風(fēng)險的認(rèn)識和能力,例如,LLM 安全事項、常見的人工智能弱點和攻擊。建立合適的跨職能團(tuán)隊,確保從一開始就將安全、風(fēng)險和合規(guī)性考慮在內(nèi)。

AI 系統(tǒng)需要大量數(shù)據(jù)進(jìn)行訓(xùn)練;有些還需要導(dǎo)入外部模型和庫。如果保護(hù)不充分,AI 系統(tǒng)可能會受到供應(yīng)鏈攻擊的破壞,或者可能容易受到 AI 模型或底層 IT 基礎(chǔ)設(shè)施中的漏洞的入侵或未經(jīng)授權(quán)的訪問。此外,如果云服務(wù)、數(shù)據(jù)中心運營或其他數(shù)字基礎(chǔ)設(shè)施中斷(例如通過拒絕服務(wù)攻擊),組織和用戶可能會失去訪問和使用 AI 工具的能力,這反過來可能會使依賴 AI 工具的系統(tǒng)癱瘓。

2.進(jìn)行安全風(fēng)險評估

采用整體流程來模擬系統(tǒng)面臨的威脅。制定/開發(fā)操作手冊和人工智能事件處理程序,縮短補(bǔ)救時間,減少不必要步驟的資源浪費。

在實踐中,需要有效區(qū)別傳統(tǒng)網(wǎng)絡(luò)風(fēng)險和基于AI的特定風(fēng)險。保護(hù) AI 系統(tǒng)會帶來傳統(tǒng) IT 系統(tǒng)中可能不熟悉的新挑戰(zhàn),除了經(jīng)典的網(wǎng)絡(luò)安全風(fēng)險外,AI 本身還容易受到新型攻擊,例如對抗性機(jī)器學(xué)習(xí) (ML),這些攻擊旨在扭曲模型的行為。

AI 與傳統(tǒng)軟件之間的根本區(qū)別在于,傳統(tǒng)軟件依賴于靜態(tài)規(guī)則和顯式編程,而 AI 使用機(jī)器學(xué)習(xí)和神經(jīng)網(wǎng)絡(luò)來自主學(xué)習(xí)和做出決策,而無需為每項任務(wù)提供詳細(xì)說明。因此,組織應(yīng)考慮比傳統(tǒng)系統(tǒng)更頻繁地進(jìn)行風(fēng)險評估,即使他們的風(fēng)險評估方法通常基于現(xiàn)有的治理和政策。這些評估還可以通過持續(xù)監(jiān)測和強(qiáng)大的反饋循環(huán)來補(bǔ)充。

3.生命周期合規(guī)

AI有五個關(guān)鍵階段 – 規(guī)劃和設(shè)計、開發(fā)、部署、運營和維護(hù)以及生命周期結(jié)束。與良好的網(wǎng)絡(luò)安全實踐一樣,CSA 建議系統(tǒng)所有者采用生命周期方法來考慮安全風(fēng)險。僅強(qiáng)化 AI 模型不足以確保全面防御 AI 相關(guān)威脅。AI 系統(tǒng)整個生命周期中涉及的所有利益相關(guān)者都應(yīng)尋求更好地了解安全威脅及其對 AI 系統(tǒng)預(yù)期結(jié)果的潛在影響,以及需要做出哪些決策或權(quán)衡。

AI 生命周期表示設(shè)計 AI 解決方案以滿足業(yè)務(wù)或運營需求的迭代過程。因此,系統(tǒng)所有者在交付 AI 解決方案時,可能會多次重新審視生命周期中的規(guī)劃和設(shè)計、開發(fā)和部署步驟。

4.確保供應(yīng)鏈安全?

評估和監(jiān)控整個系統(tǒng)生命周期的供應(yīng)鏈安全。應(yīng)用軟件開發(fā)生命周期(SDLC)流程。使用軟件開發(fā)工具檢查不安全的編碼實踐。考慮在系統(tǒng)設(shè)計中實施零信任原則。在AI供應(yīng)鏈端,確保數(shù)據(jù)、模型、編譯器、軟件庫、開發(fā)工具和應(yīng)用程序來自可信來源。使用自動數(shù)據(jù)發(fā)現(xiàn)工具識別各種環(huán)境中的敏感數(shù)據(jù),包括數(shù)據(jù)庫、數(shù)據(jù)湖和云存儲。不受信任的第三方模型是從公共/私有資源庫中獲取的模型,其發(fā)布者的來源無法驗證。

5. 訓(xùn)練數(shù)據(jù)安全

考慮是否需要使用 PII 或敏感數(shù)據(jù)來生成模型將引用的矢量數(shù)據(jù)庫,例如在使用檢索增強(qiáng)生成 (RAG) 時。考慮與使用敏感數(shù)據(jù)進(jìn)行模型訓(xùn)練相關(guān)的權(quán)衡。企業(yè)在決定是否將敏感數(shù)據(jù)用于模型訓(xùn)練之前,不妨探索各種風(fēng)險緩解措施,以確保非公開敏感數(shù)據(jù)的安全,例如匿名化和隱私增強(qiáng)技術(shù)。

6. 外部模型使用

對于 LLMs,提示工程最佳實踐(如使用護(hù)欄和在單對加鹽序列標(biāo)記中包裝指令)可作為進(jìn)一步鞏固模型的方法。對數(shù)據(jù)收集、數(shù)據(jù)存儲、數(shù)據(jù)處理和數(shù)據(jù)使用以及代碼和模型安全性進(jìn)行數(shù)據(jù)安全控制。

7. 記錄標(biāo)識

了解人工智能相關(guān)資產(chǎn)的價值,包括模型、數(shù)據(jù)、提示、日志和評估,制定跟蹤、驗證、版本控制和保護(hù)資產(chǎn)的流程。建立數(shù)據(jù)和軟件許可證管理流程。這包括記錄數(shù)據(jù)、代碼、測試用例和模型,包括任何更改和更改人。對于 PII 等敏感數(shù)據(jù),在輸入人工智能之前,應(yīng)探索各種風(fēng)險緩解措施,以確保非公開敏感數(shù)據(jù)的安全,如數(shù)據(jù)匿名化和隱私增強(qiáng)技術(shù)。

8.確保人工智能開發(fā)環(huán)境的安全

對應(yīng)用程序接口、模型和數(shù)據(jù)、日志以及它們所處的環(huán)境實施適當(dāng)?shù)脑L問控制。根據(jù)最少特權(quán)原則,對開發(fā)環(huán)境進(jìn)行基于規(guī)則和角色的訪問控制。定期審查角色沖突或違反職責(zé)分工的情況,并應(yīng)保留包括補(bǔ)救措施在內(nèi)的文件。對于已離職的用戶或不再需要訪問權(quán)限的員工,應(yīng)立即取消其訪問權(quán)限。實施訪問記錄和監(jiān)控。

9.建立事件管理程序

確保制定適當(dāng)?shù)氖录憫?yīng)、升級和補(bǔ)救計劃。制定不同的事件響應(yīng)計劃,以應(yīng)對不同類型的故障和可能與 DOS 混合的潛在攻擊情景。實施取證支持,防止證據(jù)被刪除。利用威脅獵取確定攻擊的全部范圍并調(diào)查歸因。

10.發(fā)布人工智能系統(tǒng)

在創(chuàng)建新模型或數(shù)據(jù)時,計算并共享模型和數(shù)據(jù)集散列/簽名,并更新相關(guān)文檔,如模型卡。在可能的情況下,考慮使用對抗測試集來驗證模型的穩(wěn)健性。系統(tǒng)負(fù)責(zé)人和項目團(tuán)隊跟進(jìn)安全測試/紅隊的結(jié)果,評估發(fā)現(xiàn)的漏洞的嚴(yán)重性,采取額外措施,如有必要,根據(jù)企業(yè)風(fēng)險管理/網(wǎng)絡(luò)安全政策,尋求相關(guān)實體(如首席信息安全官)的批準(zhǔn),以接受殘余風(fēng)險。

11.運營和維護(hù)

監(jiān)控人工智能系統(tǒng)輸入,監(jiān)控和記錄對系統(tǒng)的輸入,如查詢、提示和請求。適當(dāng)?shù)娜罩居涗浻兄诤弦?guī)、審計、調(diào)查和補(bǔ)救。人工智能系統(tǒng)所有者可考慮監(jiān)控和驗證輸入提示、查詢或應(yīng)用程序接口請求,以防有人試圖訪問、修改或外泄組織視為機(jī)密的信息。如果可能,防止用戶持續(xù)高頻率地查詢模型。

聲明:本文來自互聯(lián)網(wǎng)法律匠,稿件和圖片版權(quán)均歸原作者所有。所涉觀點不代表東方安全立場,轉(zhuǎn)載目的在于傳遞更多信息。如有侵權(quán),請聯(lián)系rhliu@skdlabs.com,我們將及時按原作者或權(quán)利人的意愿予以更正。

- ISC.AI 2025正式啟動:AI與安全協(xié)同進(jìn)化,開啟數(shù)智未來

- 360安全云聯(lián)運商座談會圓滿落幕 數(shù)十家企業(yè)獲“聯(lián)營聯(lián)運”認(rèn)證!

- 280萬人健康數(shù)據(jù)被盜,兩家大型醫(yī)療集團(tuán)賠償超4700萬元

- 推動數(shù)據(jù)要素安全流通的機(jī)制與技術(shù)

- RSAC 2025前瞻:Agentic AI將成為行業(yè)新風(fēng)向

- 因被黑致使個人信息泄露,企業(yè)賠償員工超5000萬元

- UTG-Q-017:“短平快”體系下的高級竊密組織

- 算力并網(wǎng)可信交易技術(shù)與應(yīng)用白皮書

- 美國美中委員會發(fā)布DeepSeek調(diào)查報告

- 2024年中國網(wǎng)絡(luò)與信息法治建設(shè)回顧